„Deepfake“ oder auch „Deepfakes“ sind Begriffe, die zuletzt immer häufiger auch im Zusammenhang mit politischem Content im Netz und in Sozialen Medien auftauchen. Was steckt hinter der Technologie, mit der Fake News mit Hilfe von Video, Bild und Stimme erzeugt oder auch ganze Identitäten gestohlen werden? Welche Gefahren haben Deepfakes für die Gesellschaft? Gibt es einen Schutz gegen diese Bedrohung? Lies hier mehr dazu.

Deepfakes: Was ist das?

Deepfakes sind künstlich erzeugte Bilder, Videos oder Audios, die mithilfe von künstlicher Intelligenz (KI) manipuliert wurden, um realistisch wirkende, aber gefälschte Inhalte zu erstellen. Dabei werden Gesichter, Stimmen oder ganze Körper von Personen verändert oder in neue Kontexte gesetzt. Ein bekanntes Beispiel ist das Bild des Papstes, der scheinbar eine weiße Daunenjacke der Marke Balenciaga trägt. Oft kann man solche gefälschten Bilder nur durch genaues Hinschauen erkennen – noch. Allerdings wird die Technologie immer besser – und man hat selten eine Lupe dabei.

Petition: Deepfakes von echten Menschen verbieten!

Autor Marc-Uwe Kling fordert: Rettet die Demokratie vor Deepfakes und manipulativen Bots!

Warum heißt es Deepfake?

Der Begriff Deepfake setzt sich aus „Deep Learning“ (eine Form der künstlichen Intelligenz) und „Fake“ (Fälschung) zusammen. Deep Learning ist eine Technik des maschinellen Lernens, die es ermöglicht, Daten – in diesem Fall Gesichter, Stimmen oder ein Video – realistisch zu imitieren. Der Name beschreibt also genau das: eine KI-gestützte, täuschend echte Fälschung.

Wie funktioniert ein Deepfake? Ist Deepfake KI?

Ja, Deepfakes basieren auf KI, genauer gesagt auf sogenannten neuronalen Netzwerken. Dabei werden Millionen von Bildern oder Audioaufnahmen einer Person analysiert. Durch Machine Learning lernt die KI, Muster zu erkennen und Gesichter, Bewegungen oder Stimmen zu imitieren. So wird das Fake-Material immer realistischer – bis es kaum noch von echten Aufnahmen zu unterscheiden ist. Während Forscher daran arbeiten, Deepfakes automatisch zu identifizieren, verbessert sich die Technologie der Fälscher parallel dazu.

Welche Deepfakes gibt es und woher kommen sie?

Deepfakes gibt es in vielen Formen – von gefälschten Videos, in denen Politiker*innen Dinge sagen, die sie nie gesagt haben, bis hin zu Audio-Deepfakes, bei denen Stimmen täuschend echt nachgeahmt werden. Auch manipulierte Bilder, die für Fake-News oder Rachepornos genutzt werden, und KI-generierte Fake-Texte, die sich als echte Nachrichten oder Social-Media-Posts tarnen, gehören dazu.

Besonders Trollfabriken, also Social-Media-Konten, die direkt oder indirekt vorgeben, ein Mensch zu sein, und Propaganda-Organisationen nutzen Deepfakes gezielt, um politische Manipulation zu betreiben. Manchmal entstehen sie auch aus harmlosen Experimenten mit künstlicher Intelligenz – doch das Missbrauchspotenzial ist riesig.

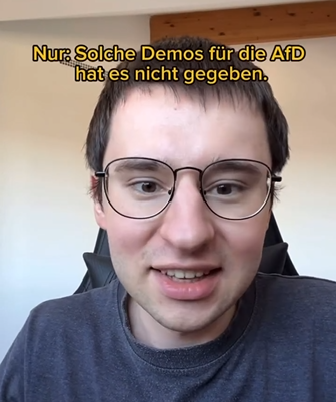

Der Blogger „polyriker“ hat sich auf Instagram verschiedene Fake News und Deepfakes angeschaut und erklärt, wozu sie erstellt werden:

Welche Folgen haben Deepfakes?

Die Folgen von solchen Videos sind gefährlich: Gefälschte Skandal-Videos können politische Desinformation verbreiten und Wahlen beeinflussen. Rufmord und Erpressung durch Fake-Pornos zerstören Leben. Promis „werben“ scheinbar für dubiose Produkte, und Cybermobbing wird durch gefälschte Inhalte noch perfider.

Selbst die Justiz ist gefährdet, wenn Deepfakes als gefälschte Beweise genutzt werden. Mit sogenannten Face Swap Apps beispielsweise kann ein wütender Ex-Freund mit wenigen Klicks das Gesicht seiner Ex-Freundin auf einen fremden Körper montieren und einen Fake-Porno erstellen (siehe auch „Deepnudes“). Deepfakes können sogar lebensbedrohlich sein: Immer wieder wird mit Deepfakes prominenter Personen aus der Medizin für wirkungslose oder schädliche Medikamente geworben.

Im Wahlkampf können Deepfakes ganz reale Folgen für unsere Demokratie haben.Denn wer sich nicht mehr sicher sein kann, ob Videos von Reden oder Wahlkampf-Auftritten wirklich echt sind, vertraut gar keinen Informationen mehr, ob echt oder fake. Die Zukunft der digitalen Glaubwürdigkeit steht auf dem Spiel. Das Vertrauen in Medien und Wahrheit wird erschüttert – und ohne Vertrauen kann eine Demokratie nicht funktionieren.

Was sind Deepnudes?

Deepnudes sind eine besonders perfide Form von Deepfakes. Dabei werden KI-Programme genutzt, um echte Fotos von Personen digital zu entkleiden oder Nacktbilder zu generieren, die es in Wirklichkeit nie gab. Diese Technik wird oft für Rachepornos, Erpressung oder Cybermobbing missbraucht. Besonders betroffen sind Frauen, die ohne ihr Wissen in Fake-Pornografie eingebaut werden.

Das ist beispielsweise der Schauspielerin Collien-Ulmen Fernandez passiert, die sich seitdem gemeinsam mit der Organisation HateAid gegen diese Deepfake-Pornos einsetzt.

Mehr Bilder von ihrer Aktion mit HateAid und WeAct findest Du auf dem flickr-Account von Campact.

Sind Deepfakes illegal oder strafbar?

Deepfakes selbst sind nicht grundsätzlich verboten, aber ihre Nutzung kann in vielen Fällen strafbar sein. Wer Deepfakes gezielt für Verleumdung, Betrug oder Manipulation einsetzt, kann sich strafrechtlich verantworten müssen. Besonders problematisch sind Deepnudes und Rachepornos, die in vielen Ländern – darunter auch Deutschland – als schwerwiegende Straftaten gelten. Seit 2021 schützt das deutsche Strafrecht Opfer solcher Deepfake-Bilder, indem die Verbreitung ohne Zustimmung unter Strafe gestellt wird. Auch Identitätsdiebstahl oder betrügerische Deepfake-Werbung kann rechtliche Konsequenzen haben.

Auf europäischer Ebene gibt es erste Versuche, den Umgang mit Deepfakes zu regulieren. Der Digital Services Act (DSA) verpflichtet Plattformen wie Facebook, Instagram oder TikTok, gegen manipulierte Inhalte vorzugehen, insbesondere wenn diese Desinformation oder politische Einflussnahme betreiben. Außerdem müssen KI-generierte Inhalte klar gekennzeichnet werden, damit Nutzer sie als solche erkennen können. Noch weiter geht die geplante KI-Verordnung der EU, die Deepfakes als potenziell „hochriskante“ Technologie einstuft. Unternehmen, die KI-gestützte Fälschungen verbreiten oder Deepfake-Tools anbieten, sollen in Zukunft strengeren Regeln unterliegen.

Trotz dieser Maßnahmen gibt es bislang kein europaweites Verbot von Deepfakes ohne Einwilligung der betroffenen Person. Kritiker*innen fordern daher klare, harte Gesetze, die Deepfake-Manipulation grundsätzlich unter Strafe stellen – bevor die Technik zur unkontrollierbaren Waffe gegen Demokratie, Privatsphäre, Wahrheit und die Glaubwürdigkeit von Nachrichten wird.

KI in der Kunst

Es gibt natürlich auch Fälle, in denen die Technik, die sonst für Deepfakes eingesetzt wird, ganz harmlos benutzt wird, zum Beispiel in der Kunst oder in Memes. Eine Zeit lang waren Videos mit Face Swapping ein Trend, in denen das Gesicht von Promis auf lustige Tanzvideos gesetzt wurde. Der Unterschied zu Deepfakes: Hier ist oft deutlich erkennbar, dass es sich um eine Montage handelt, die der Unterhaltung dienen soll. Betroffene Promis fanden den Trend zum Teil sogar lustig. Trotzdem ist dieses Verfahren auch hier kritisch zu sehen. Denn was auch bei vermeintlich lustigen Videos mit Face Swapping der Fall ist: Die Zustimmung der Betroffenen ist oft nicht gegeben. Außerdem trainieren auch solche Videos, die nur zum Spaß erstellt werden, die KI. So wird sie nur besser und kann noch effektiver zur Verzerrung der Realität und Bedrohung der Gesellschaft eingesetzt werden.

Welche bekannten Beispiele von Deepfakes gibt es?

1. Tom Cruise – TikTok-Deepfake

Ein Deepfake-Account auf TikTok mit dem Namen „DeepTomCruise“ postet ein Video, in welchem ein scheinbar echter Tom Cruise zu sehen war, der Witze machte, Golf spielte und mit den Fans interagierte. Tatsächlich aber steckte ein Schauspieler dahinter, dessen Gesicht mit KI-Technologie so bearbeitet wurde, dass er wie der Hollywood-Star aussah.

2. Barack Obama – Deepfake-Warnvideo

Der Regisseur und Comedian Jordan Peele nutzte KI-Technologie, um ein Deepfake-Video von Barack Obama zu erstellen. In dem Clip beleidigt der „gefälschte“ Ex-Präsident den derzeitgen Präsidenten der USA Donald Trump und warnt gleichzeitig vor der Gefahr von Deepfakes. Peele ließ Obama Dinge sagen, die dieser nie gesagt hatte – um zu zeigen, wie gefährlich solche Manipulationen für politische Meinungen und die Demokratie sein können.

3. Wolodymyr Selenskyj – Deepfake-Kapitulationsvideo

Das Deepfake-Video des ukrainischen Präsidenten Wolodymyr Selenskyj zeigt ihn, wie er angeblich zur Kapitulation der Ukraine aufruft. In Wahrheit handelte es sich um eine gefälschte Botschaft, die von pro-russischen Akteuren erstellt und verbreitet wurde. Das Video wurde zwar schnell entlarvt, zeigte aber eindrucksvoll, wie Deepfakes als Waffe der Propaganda und psychologischen Kriegsführung eingesetzt werden können.

Promis gegen Deepfake-Menschen

Der Bestsellerautor Marc-Uwe Kling hat eine Petition auf WeAct, der Petitionsplattform von Campact e.V., gestartet. Er fordert ein Verbot von Deepfakes und manipulativen Bots – Social-Media-Konten, die direkt oder indirekt vorgeben, ein Mensch zu sein – um die Demokratie vor gezielten Fälschungen zu schützen. Für ihn ist es eine grundsätzliche Frage der Demokratie: Ohne Vertrauen funktioniert sie nicht. Und dieses Vertrauen wird nachhaltig zerstört, wenn nicht mehr zwischen Echt und Unecht unterschieden werden kann.

Auch Bestseller-Autor Yuval Noah Harari warnt: „Bots haben keine Redefreiheit – Menschen schon!“ Und Star-Philosoph Daniel Dennett geht noch weiter: „Diese gefälschten Menschen sind die gefährlichsten Artefakte der Menschheitsgeschichte!“

Richtig viele Prominente unterstützen Marc-Uwe Kling bereits: Die Liste der Unterzeichner*innen liest sich wie das Who-is-Who der deutschen Unterhaltungs- und Kulturszene. Mit dabei sind Sarah Bosetti, Nina George, Robert Gwisdek, Michael „Bully“ Herbig, Karoline Herfurth, Nora Imlau und viele, viele mehr. Die vollständige Liste der Erstunterzeichner*innen findest Du hier.

Petition: Soziale Netzwerke als demokratische Kraft retten!

Über 250.000 Menschen fordern: Demokratiestärkende Angebote müssen ausgebaut werden, demokratieschädliche Plattformmonopole sollten ihre massiven Privilegien umgehend verlieren.

Forderungen an die Politik

Die EU plant lediglich eine Kennzeichnungspflicht für KI-generierte Inhalte. Doch das reicht nicht. Die WeAct-Petition fordert ein generelles Verbot von Deepfakes, die ohne Einwilligung der gezeigten Personen erstellt werden, und Strafen für die Verbreitung solcher Manipulationen – genau wie beim Fälschen von Geld. Denn ohne Regulierung und Vertrauen kann weder eine Währung noch eine Demokratie funktionieren.

Gerade jetzt formiert sich in Deutschland eine neue Regierung – eine einmalige Chance, klare Regeln zu schaffen. Die Politik darf nicht warten, bis die digitale Manipulation unsere Demokratie unwiderruflich untergräbt. Jetzt ist der richtige Moment, um echte Schutzgesetze zu fordern!

Ob national, lokal oder regional: Bei WeAct kannst Du in wenigen Schritten Deine Petition starten. Langjährige Erfahrung, Expertise rund um Strategie, Kommunikation und Aktionsplanung: Bei WeAct teilen erfahrene Campaigner*innen dieses Wissen mit Dir und unterstützen Dich dabei, Deine Petition zum Erfolg zu bringen.

Ganz wichtig: Für Rechtspopulist*innen oder andere Demokratie-Feinde hat WeAct keinen Platz. Wir unterstützen Petitionen, die sozialen, ökologischen und demokratischen Fortschritt vorantreiben. Reichweite und Beratung kann man bei WeAct nicht kaufen – wir arbeiten mit Deiner Petition aus Überzeugung!

Du willst jetzt gerne eine schlagkräftige Petition erstellen, aber weißt nicht wie? Hier findest Du Tipps, damit Deine Petition Erfolg hat.